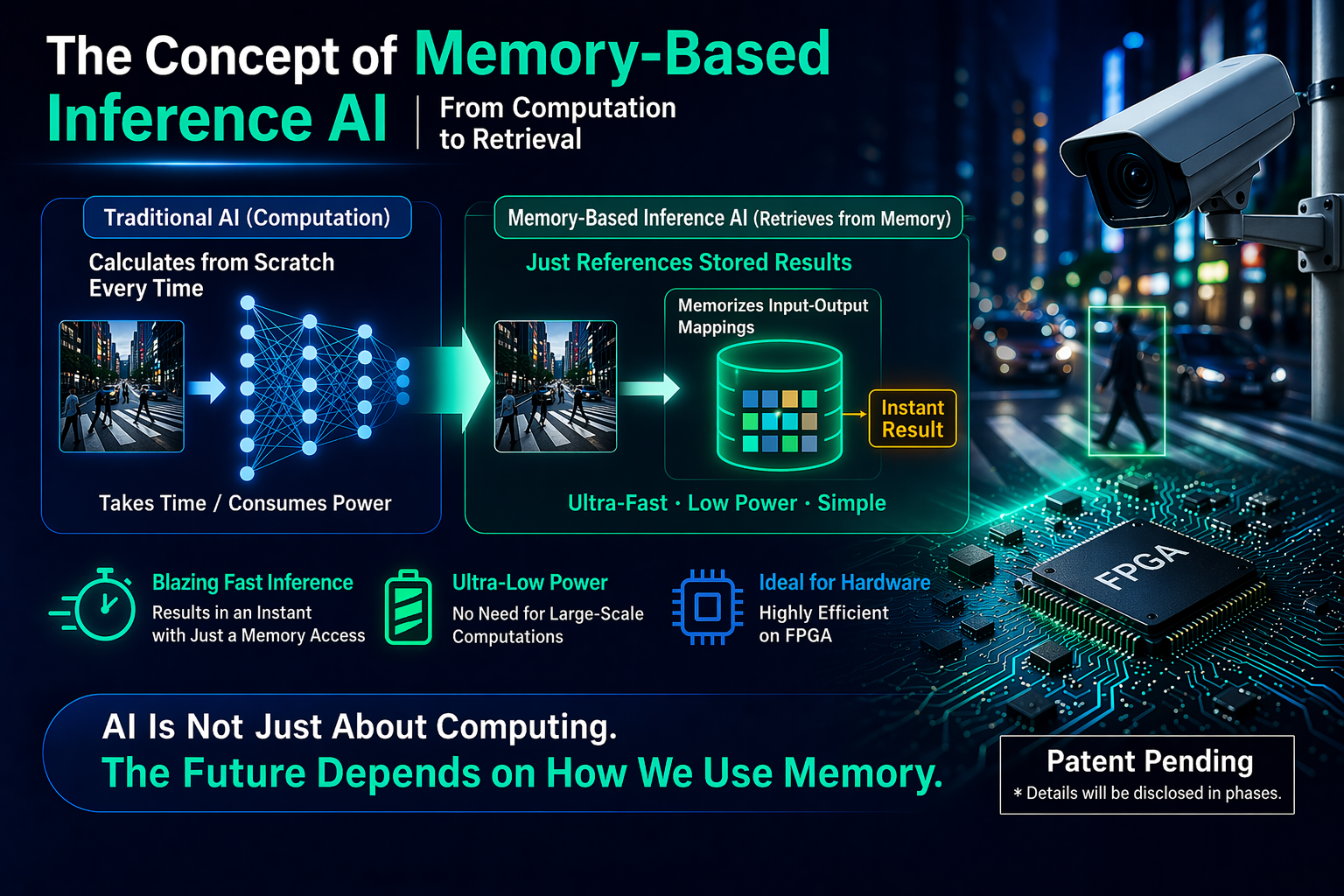

一般的なAIでは、多くの演算を積み重ねて推論結果を求めます。 メモリ推論AIでは、学習や事前準備によって得られた情報を記憶領域に対応付けし、 入力に対してできるだけ直接的に結果を取り出す方向を目指します。

これは、従来の演算中心の方式とは異なる視点から、 速度や消費電力、実装方法の可能性を探る試みです。

入力から結果までの流れをできるだけ短くし、 反応速度の高い推論を目指します。

大量の演算を減らせるなら、 システム全体の消費電力を抑えられる可能性があります。

記憶とデータの流れを重視するこの考え方は、 FPGAによる実装や実験とも相性が良いと考えています。

メモリ推論AIは、完成済みの製品として提供しているものではありません。 現在は、構想・研究・実証の段階にあるテーマです。

ただし、既存のAIの延長だけではない別の可能性として、 今後の実装や応用を見据えて取り組んでいます。

このページでは、公開可能な範囲で概要を紹介しています。詳細な実装や評価については、今後段階的に発信していく予定です。

FPGAForgeは「言葉から回路へ」を目指す入口です。 メモリ推論AIは、その先にある技術的な挑戦のひとつです。

すぐに使えるサービスと、将来につながる研究。 その両方を並行して進めていくことで、 実用と新しい可能性の両方に向き合っていきます。

問い合わせはフォームからお願いします。

問い合わせ先